확장되는 AI 세계 탐색: MCP, A2A, 그리고 비인간 신원 보안의 중요성에 대한 심층 이해

By

Ben Kim

November 17, 2025

9분 읽기

By

Ben Kim

November 17, 2025

9분 읽기

.png)

인공지능의 빠른 발전은 더 이상 이론에만 머무르지 않고, Anthropic의 모델 컨텍스트 프로토콜(MCP)과 Google의 에이전트-투-에이전트 프로토콜(A2A) 같은 실질적인 프로토콜로 구체화되고 있습니다. 이전에 논의했듯이, 이러한 프로토콜들은 AI 에이전트가 외부 도구와 원활하게 상호작용하고 서로 직접 협업할 수 있는 미래를 위한 길을 열어주며, 전례 없는 수준의 자동화와 효율성을 약속합니다. 그러나 이렇게 증가된 정교함과 상호 연결성은 본질적으로 보안 문제, 특히 비인간 신원(NHI)과 관련된 문제를 증폭시킵니다. 이 확장된 논의에서는 MCP와 A2A의 복잡성, 잠재적인 보안 영향, 그리고 이 진화하는 환경에서 NHI 보안 확보가 왜 점점 더 중요해지는지에 대해 더 깊이 탐구할 것입니다.

Anthropic의 모델 컨텍스트 프로토콜(MCP)은 거대 언어 모델(LLM)과 AI 에이전트가 API, 데이터베이스, 파일 시스템과 같은 외부 리소스에 안전하게 연결될 수 있도록 하는 중요한 다리 역할을 합니다. MCP와 같은 표준화된 프로토콜이 등장하기 전에는 AI와 외부 도구를 통합하는 데 종종 각 도구에 대한 비효율적인 맞춤형 개발이 필요했습니다. MCP는 이 과정을 간소화하도록 설계된 플러그형 프레임워크를 제공하여, 보다 표준화된 방식으로 AI의 역량을 확장합니다. 2024년 말 도입 이후, MCP는 Claude Desktop 및 Cursor와 같은 주류 AI 애플리케이션에서 상당한 채택을 보였으며, 다양한 MCP 서버 마켓플레이스가 등장하여 성장하는 생태계를 나타내고 있습니다.

그러나 이러한 빠른 채택은 새로운 보안 취약점을 드러내기도 했습니다. 현재 MCP 아키텍처는 일반적으로 세 가지 주요 구성 요소를 포함합니다:

이러한 다중 구성 요소 상호작용은 특히 여러 인스턴스와 구성 요소 간 협업 시나리오에서 다양한 보안 위험을 초래합니다. Invariant Labs가 강조한 도구 중독 공격(TPA)은 심각한 우려 사항입니다. 이러한 공격은 악의적인 지침이 도구 설명 내에, 종종 MCP 코드 주석에 숨겨져 포함될 수 있다는 사실을 악용합니다. 이러한 숨겨진 지침은 단순화된 UI에서는 사용자에게 보이지 않을 수 있지만, AI 모델은 이를 처리합니다. 이는 Cursor를 통해 WhatsApp 데이터를 유출하는 시나리오에서 입증되었듯이, AI 에이전트가 민감한 파일을 읽거나 개인 데이터를 유출하는 등 승인되지 않은 작업을 수행하게 만들 수 있습니다.

TPA의 기본 메커니즘은 종종 간단합니다. 예를 들어, 악의적인 MCP 코드는 처음에는 무해해 보일 수 있지만 나중에 도구의 독스트링(docstring)을 숨겨진 지침으로 덮어써서 사용자의 인지나 동의 없이 이메일 수신자를 리디렉션하거나 민감한 로컬 파일에 접근할 수 있습니다.

이러한 위험을 고려할 때, MCP 구현을 위한 몇 가지 보안 고려 사항이 가장 중요합니다:

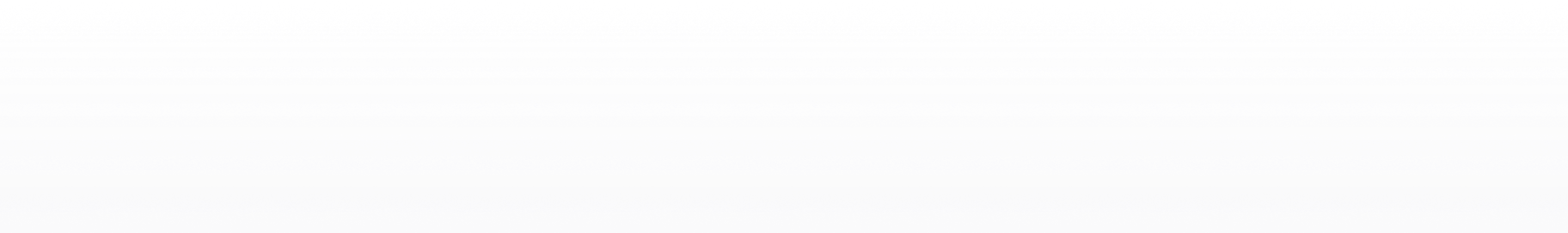

이러한 약점을 해결하기 위해 MCP 사양은 관리형 권한으로 클라이언트-서버 상호 작용을 보호하기 위한 OAuth 2.1 인증 지원을 포함하도록 업데이트되었습니다. 보안 및 신뢰/안전에 대한 주요 원칙은 이제 사용자 동의 및 제어, 데이터 프라이버시, 도구 보안(특히 코드 실행)에 대한 신중한 처리, LLM 샘플링 요청에 대한 사용자 제어를 강조합니다. 또한, 커뮤니티는 도구 설명 내 지침 구문 표준화, 세분화된 제어를 위한 권한 모델 개선, 무결성 및 진위 보장을 위한 도구 설명 디지털 서명 의무화 또는 강력 권장과 같은 추가 개선 사항을 제안했습니다.

MCP의 AI-도구 통신 초점과는 대조적으로, Google의 에이전트-투-에이전트 프로토콜(A2A)은 AI 에이전트 상호 운용성을 위한 개방형 표준으로 특별히 설계되어 지능형 에이전트 간의 직접적인 통신과 협업을 가능하게 합니다. Google은 A2A를 MCP를 보완하는 것으로 포지셔닝하며, 에이전트들이 함께 작동하여 복잡한 기업 워크플로우를 자동화하고 전례 없는 수준의 효율성과 혁신을 추진할 필요성을 해결하는 것을 목표로 합니다. 이 이니셔티브는 기반 기술에 관계없이 AI 에이전트가 원활하게 협업할 수 있는 미래에 대한 공유된 비전을 반영합니다.

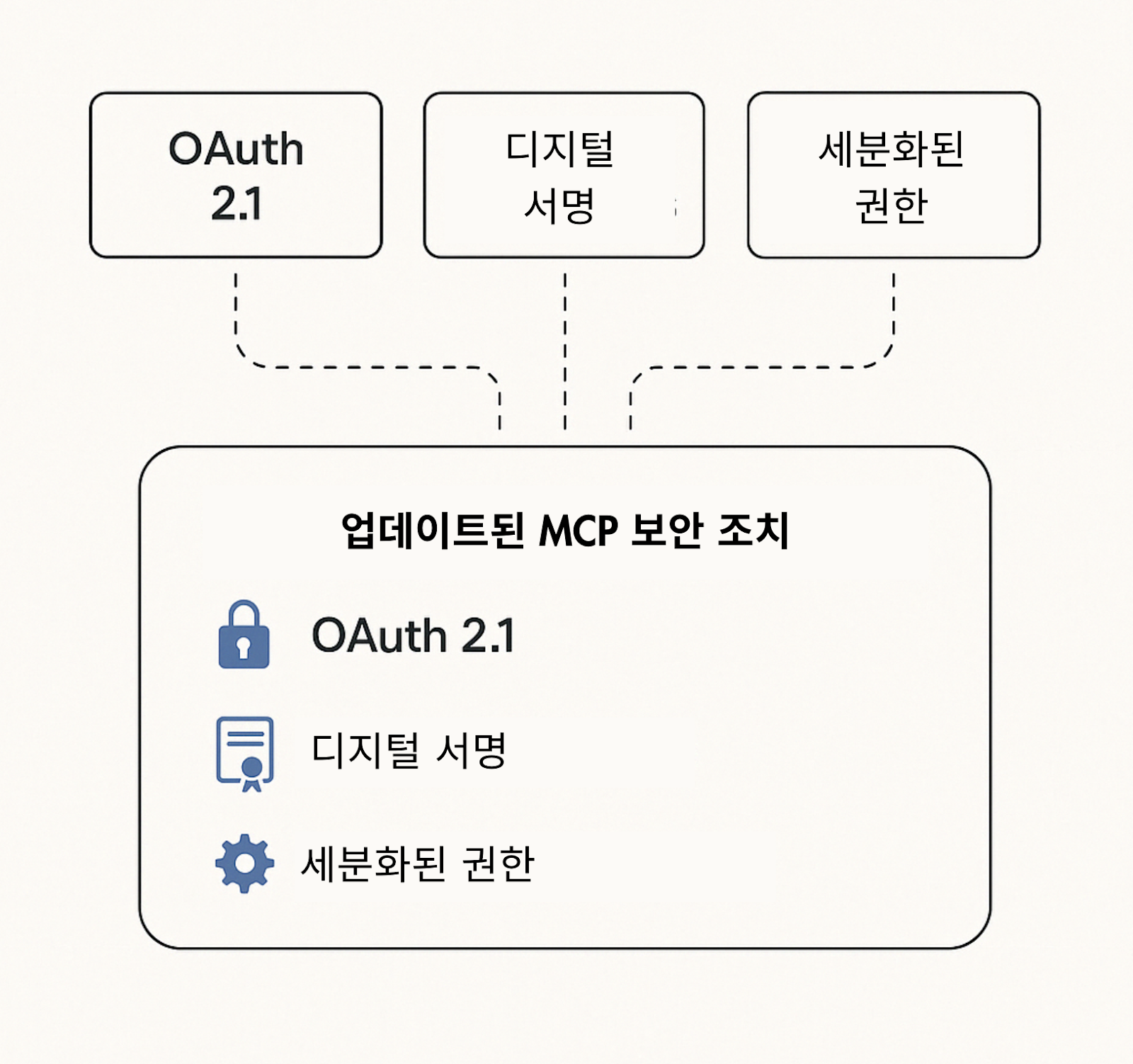

A2A는 다섯 가지 핵심 설계 원칙을 기반으로 합니다:

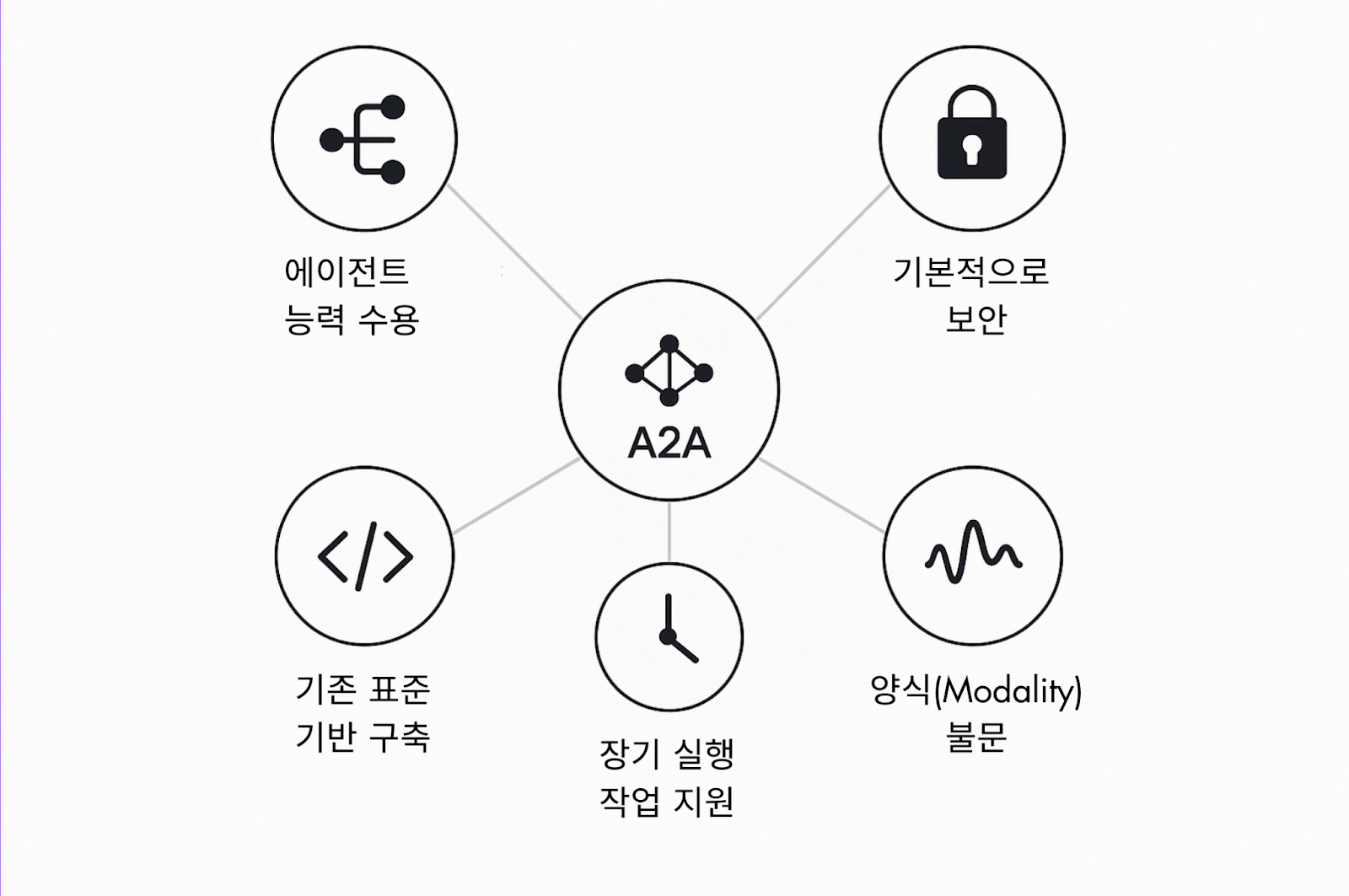

A2A는 작업을 공식화하는 "클라이언트" 에이전트와 해당 작업을 수행하는 "원격" 에이전트 간의 통신을 촉진합니다. 이는 몇 가지 핵심 기능을 포함합니다:

실제 예로는 후보자 소싱이 있습니다: 채용 관리자의 에이전트가 소싱 및 배경 확인 에이전트에게 작업을 지시하며, 이 모든 것이 통합 인터페이스 내에서 이루어집니다.

Google은 A2A에 대해 "기본적으로 보안" 설계를 강조하며, 표준 보안 메커니즘을 통합합니다:

초기 MCP 사양과 비교할 때, A2A는 내장된 보안 기능에 대해 더 성숙한 접근 방식을 보이는 것 같습니다. 그러나 에이전트 간 통신에 중점을 둔다는 것은 많은 A2A 엔드포인트가 공개적으로 접근 가능할 수 있음을 의미하며, 이는 잠재적으로 취약점 영향을 증가시킬 수 있습니다. A2A 개발자에게는 높은 보안 인식이 중요합니다.

Google 개발자 블로그는 A2A가 MCP를 보완하도록 설계되었다고 명시적으로 밝히고 있습니다. A2A는 에이전트 간 통신에 초점을 맞추지만, MCP는 에이전트에게 유용한 도구와 컨텍스트를 제공합니다. AI 에이전트는 MCP를 사용하여 데이터베이스와 상호 작용하고, 그런 다음 A2A를 사용하여 다른 AI 에이전트와 협력하여 해당 정보를 처리하거나 복잡한 작업을 완료할 수 있습니다.

구조적으로 A2A는 독립적인 에이전트가 있는 클라이언트-서버 모델을 따르는 반면, MCP는 LLM을 중심으로 하는 애플리케이션-LLM-도구 구조 내에서 작동합니다. A2A는 독립적인 개체 간의 직접적인 통신을 강조하고, MCP는 외부 도구를 통해 단일 LLM의 기능을 확장하는 데 중점을 둡니다.

두 프로토콜 모두 현재 에이전트 등록 및 검색을 위해 수동 구성이 필요합니다. MCP는 초기 시장 진입과 더 확립된 커뮤니티의 이점을 누립니다. 그러나 A2A는 Google과 증가하는 파트너 목록의 지원을 받아 빠르게 견인력을 얻고 있습니다. 지배적인 분위기는 MCP와 A2A가 경쟁하기보다는 상호 보완 또는 통합 방향으로 진화하여 개발자에게 더 개방적이고 표준화된 옵션을 제공할 가능성이 높다는 것을 시사합니다.

AI 에이전트가 MCP 및 A2A와 같은 프로토콜을 통해 점점 더 자율적이고 상호 연결됨에 따라, 그들이 의존하는 비인간 신원(NHI)의 보안이 가장 중요해집니다. 서비스 계정, API 키, 토큰, 인증서를 포함하는 NHI는 AI 에이전트가 리소스에 접근하고 다른 시스템과 상호 작용할 수 있도록 하는 자격 증명 역할을 합니다. 현대 기업 내 NHI의 엄청난 양과 다양성은 이미 상당한 관리 및 보안 문제를 제기합니다. 광범위한 AI 에이전트 상호 작용의 등장은 이러한 문제를 증폭시키고 새로운 위험을 초래할 것입니다.

MCP 및 A2A와 함께 등장하는 보안 위협은 강력한 NHI 보안의 시급성을 강조합니다:

NHI의 동적이고 종종 분산된 특성을 고려할 때, 전통적인 보안 접근 방식은 종종 부적절합니다. 인간 사용자와 달리 NHI는 명확한 소유권이나 수명 주기 관리가 부족한 경우가 많습니다. 따라서 비인간 신원 보안에 대한 집중적인 관심은 AI 에이전트 상호 운용성을 수용하는 조직에게 기본 요구 사항이 됩니다.

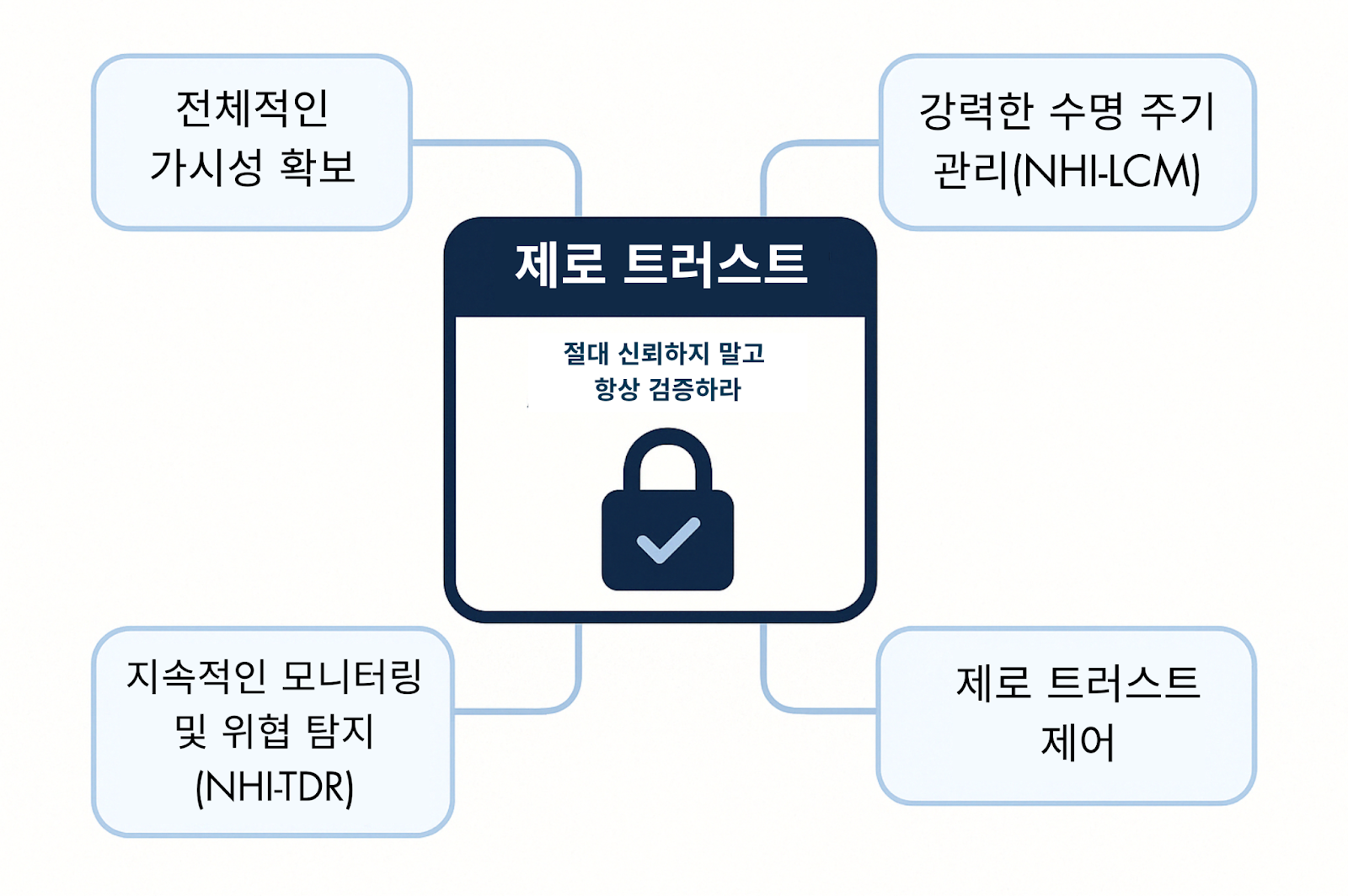

"절대 신뢰하지 말고 항상 검증하라"는 제로 트러스트 보안 모델은 이 환경에서 NHI에게 더욱 중요해집니다. NHI를 활용하는 AI 에이전트의 모든 접근 요청은 위험을 최소화하기 위해 지속적으로 검증되어야 합니다.

조직의 NHI 보안 태세를 강화하기 위해 다음 전략을 고려하십시오:

크레밋(Cremit)과 같은 회사는 비인간 신원 보안에 중점을 둔 솔루션을 제공함으로써 이러한 문제를 구체적으로 해결하고 있습니다. 그들의 NHI 보안 플랫폼은 조직이 비인간 신원에 대한 가시성을 확보하고 수명 주기를 효과적으로 관리하도록 돕습니다. 크레밋의 기술은 MCP 및 A2A 환경에서 잠재적으로 악용될 수 있는 NHI 관련 위험을 탐지하고 완화하는 것을 목표로 합니다. 예를 들어, 크레밋은 AWS Bedrock(Claude+MCP 포함)과 같은 플랫폼을 사용하여 NHI 행동을 분석하고 상황 인식 위협 정보를 제공하는 기능을 개발하고 있습니다. 그들의 플랫폼은 개발/협업 도구에서 노출된 비밀을 탐지하고 해결 지침을 제공하는 것을 목표로 합니다. 크레밋의 집중은 이 중요한 필요성에 대한 인식이 증가하고 있음을 강조합니다.

MCP 및 A2A와 같은 프로토콜의 등장은 AI 에이전트 기능과 상호 연결성에서 기념비적인 도약을 의미합니다. 변혁적인 이점을 약속하는 동시에 비인간 신원을 중심으로 한 새로운 보안 과제를 야기합니다. 종종 간과되는 이러한 디지털 자격 증명을 확보하는 것은 더 이상 부차적인 관심사가 아니라 AI 에이전트 상호 운용성의 잠재력을 안전하고 신뢰할 수 있게 실현하기 위한 기본 전제 조건입니다. 강력한 비인간 신원 보안 전략을 우선시하고 구현함으로써 조직은 확장되는 이 AI 세계를 자신 있게 탐색하고, 진화하는 위험을 완화하며, 더 안전하고 지능적인 미래를 구축할 수 있습니다.

.png)

Need answers? We’ve got you covered.

Below are some of the most common questions people ask us. If you can’t find what you’re looking for, feel free to reach out!

We specialize in high-converting website design, UX/UI strategy, and fast-launch solutions for SaaS and startup founders.

Helping SaaS and startup founders succeed with conversion-focused design, UX strategy, and quick deployment.

Designing sleek, user-focused websites that help SaaS and startup teams launch faster and convert better.

We design and launch beautiful, conversion-optimized websites for ambitious SaaS and startup founders.